模型上下文协议 MCP #

随着人工智能迈向更复杂的应用场景,单一模型的局限性逐渐显现,而多模型协同与上下文感知的需求日益迫切。从对话系统需要理解用户的历史语境,到跨模态任务要求无缝整合文本、图像等多源数据,AI 的发展正呼唤一种全新的协作范式。

模型上下文协议(Model Context Protocol, MCP)正是在这一背景下崭露头角。作为一种专为模型间上下文传递设计的标准化协议,MCP 不仅提升了系统的连贯性和智能化水平,还为开发者提供了一个灵活、高效的工具来应对日益增长的计算挑战。

MCP 协议由 Anthropic 于 2024 年 11 月正式推出并开源。作为一家由前 OpenAI 研究人员创立的公司,Anthropic 以其在可解释性和安全 AI 系统方面的专长而闻名。

MCP 的设计初衷是创建一个开放协议,标准化 AI 模型与外部数据源及工具的交互方式,从而解决传统集成的碎片化问题。

MCP 的灵感部分来源于 USB-C 的类比:如同 USB-C 通过统一接口连接多种设备,MCP 旨在为 AI 应用提供一个“即插即用”的上下文管理框架。

MCP 架构 #

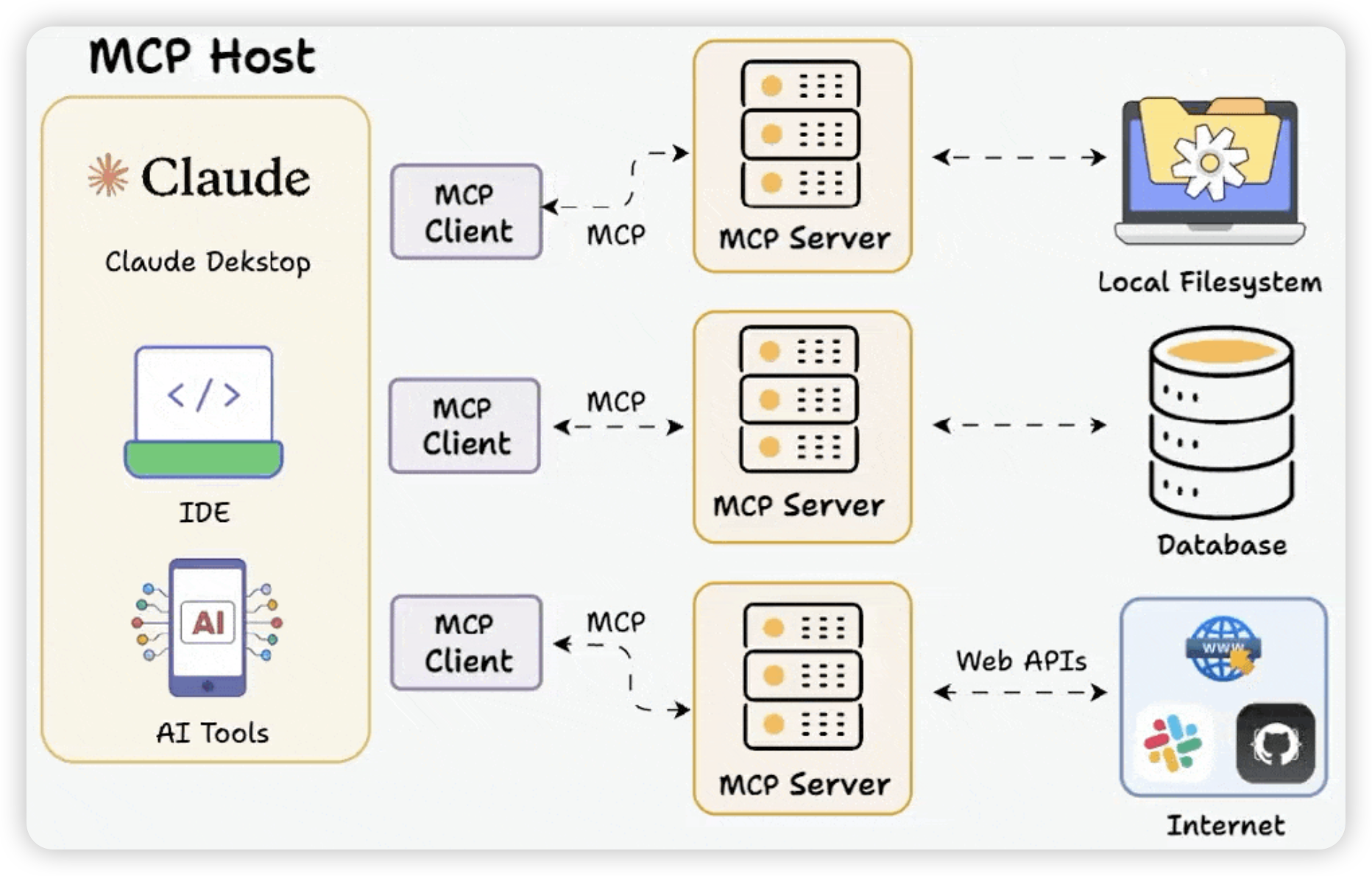

模型上下文协议(Model Context Protocol, MCP)的核心设计遵循客户端-服务器架构,这一架构允许一个宿主应用程序与多个服务器建立连接,从而实现灵活的上下文传递与功能扩展。

通常而言,MCP 的技术框架围绕三个关键组件构建:主机(Host)、客户端(Client)和服务器(Server)。这些组件共同协作,形成了一个高效、可扩展的生态系统,为 AI 模型与外部资源之间的动态交互提供了坚实的基础。

简单来说,用户在 MCP Host 上发出指令,Host 通过 MCP Client 和 MCP Server 沟通,最终实现功能并返回结果给用户。

- MCP Host(宿主/主机):用户操作 MCP 服务的平台,比如 AI 聊天工具或专业 IDE。

- 管理客户端:生成并管理多个客户端(会话),控制安全性和权限。

- 协调 AI:决定 AI(LLM)使用哪些数据或功能,并向服务器发送请求。

- 整合信息:汇总各客户端从服务器获取的数据,供 AI 优化使用。

- MCP Client(客户端):连接 Host 与 Server,负责数据交互与通信。

- 专用通信:一个客户端只与一个服务器交互,例如“数据库客户端”或“翻译客户端”。

- JSON-RPC 交互:使用 initialize、call_tool、read_resource 等方法与服务器通信。

- 事件处理:接收服务器的日志通知等,并反馈给主机。

- 实现要点

- 客户端实现较简单,主要包括

ClientSession(协议层)和传输模块(如stdio_client、sse_client、websocket_client)。 ClientSession负责生成和发送JSON-RPC消息,处理核心操作(如initialize、tools/call)。- 传输层使用 stdio 或 SSE 交换 JSON 消息。

- 客户端实现较简单,主要包括

- MCP Server(服务端):实际提供功能和数据支持的程序,比如访问文件、调用数据库、调用API。

- 提供工具和资源:公开功能(如翻译、数据库查询、文件读写)供客户端调用。

- 隔离操作:为安全起见,仅处理自身权限内的资源,不直接访问主机或其他服务器数据。

- 可选 AI 交互:通过客户端向主机的 LLM 请求额外处理(例如,翻译服务器请求其他语言处理)。

- 实现要点

- 提供低级 Server 类和高级 FastMCP框架。

- Server使用装饰器(如

@server.call_tool、@server.list_tools)定义请求处理逻辑,管理“哪个方法调用哪个函数”。 ServerSession为每个客户端连接生成会话,处理JSON-RPC消息并调用注册的处理函数。FastMCP自动配置 SSE 路由和工具管理,简化开发。- 传输层与客户端类似,使用 stdio 或 SSE。

设计原则 #

MCP 的设计遵循以下原则:

- 服务器简洁:服务器专注单一功能,复杂协调由主机负责。

- 高组合性:通过通用协议,服务器如积木般可自由组合,扩展 AI 功能。

- 权限隔离:服务器仅操作自身权限内的资源,主机负责全局管理。

- 渐进扩展:核心功能保持最小化,通过“功能协商”(capability negotiation)逐步添加扩展,兼顾后向兼容性。